Los casos podrían afectar significativamente el poder y las responsabilidades de las plataformas de medios sociales.

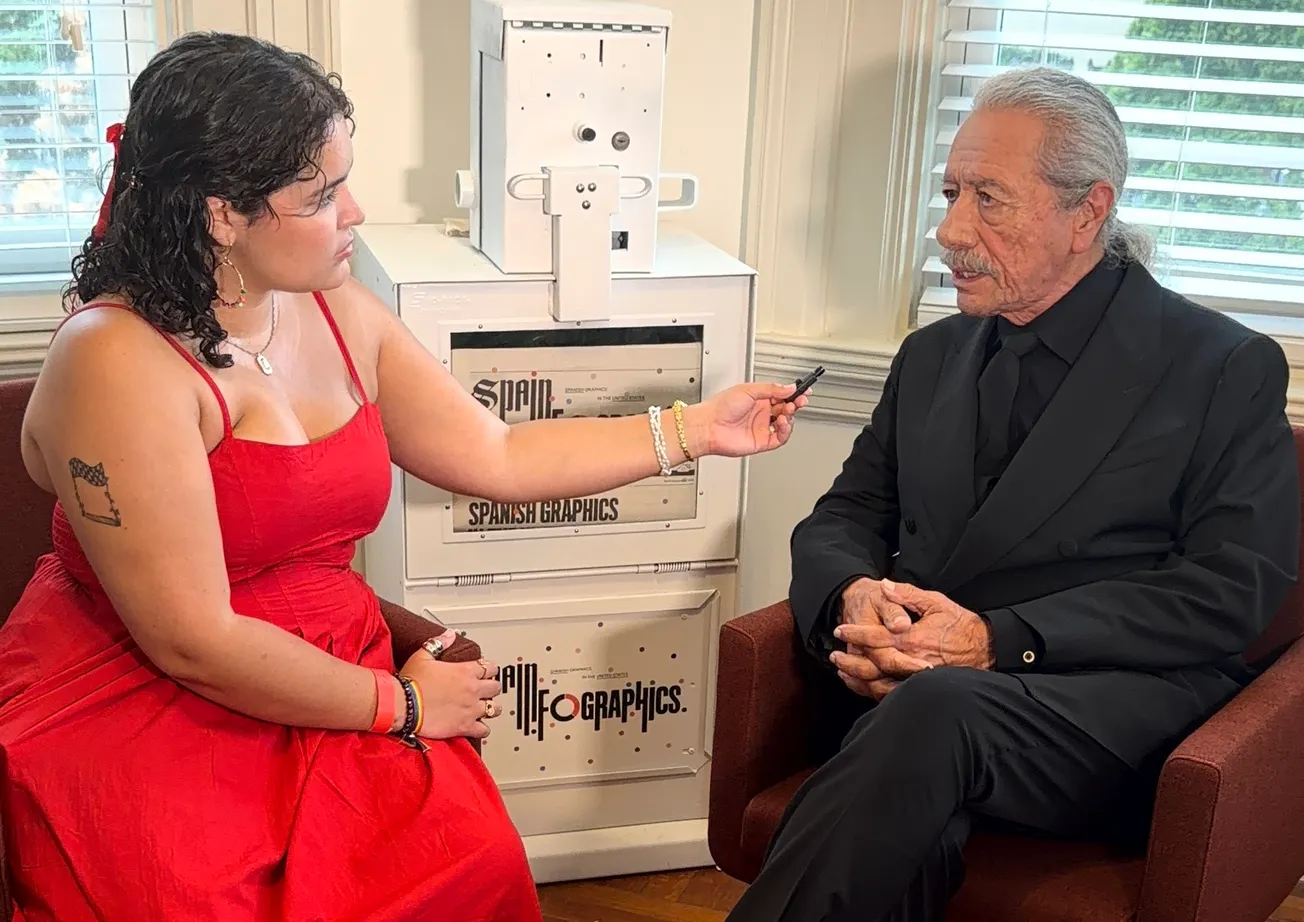

Durante años, las redes sociales gigantes como Facebook, Twitter e Instagram han funcionado basándose en dos principios fundamentales.

El primero es que las plataformas tienen el poder de decidir qué contenidos mantienen en línea y cuáles retiran, sin ninguna supervisión gubernamental. El segundo es que los sitios web no pueden ser considerados legalmente responsables de la mayor parte de lo que sus usuarios publican en línea; lo cual protege a las empresas de demandas por expresiones difamatorias, contenido extremista y daños en el mundo real relacionados con sus plataformas.

Ahora, el Tribunal Supremo está a punto de reconsiderar esas normas, lo que podría dar lugar al mayor cambio de las doctrinas que rigen la libre expresión en línea desde que las autoridades y los tribunales estadounidenses decidieron aplicar pocas regulaciones sobre la internet en la década de los noventa.

Se espera que el Tribunal Supremo debata mañana viernes si acepta dos casos que cuestionan las leyes de Texas y Florida que prohíben a las plataformas en línea retirar determinados contenidos políticos. El mes que viene está previsto que el tribunal trate un caso que cuestiona la sección 230, una ley de 1996 que protege a las plataformas de la responsabilidad por los contenidos publicados por sus usuarios.

Los casos podrían acabar alterando la postura legal de no intervención que Estados Unidos ha adoptado en gran medida hacia la expresión en línea, poniendo potencialmente en peligro los negocios de TikTok, Twitter, Snap y Meta, propietaria de Facebook e Instagram.

"Es un momento en el que todo podría cambiar", dijo Daphne Keller, ex abogada de Google que dirige un programa en el Centro de Política Cibernética de la Universidad de Stanford.

Los casos forman parte de una creciente batalla mundial sobre cómo tratar la expresión nociva en Internet. En los últimos años, a medida que Facebook y otros sitios atraían a miles de millones de usuarios y se convertían en influyentes vías de comunicación, el poder que ejercían fue objeto de un creciente escrutinio. Surgieron preguntas sobre cómo las redes sociales podrían haber afectado indebidamente a elecciones, genocidios, guerras y debates políticos.

Es probable que el caso del Tribunal Supremo que cuestiona la sección 230 de la Ley de Decencia en las Comunicaciones tenga muchas repercusiones. Mientras que los periódicos y revistas pueden ser demandados por lo que publican, la sección 230 protege a las plataformas en línea de demandas por la mayoría de los contenidos publicados por sus usuarios. También protege de demandas a las plataformas cuando éstas retiran publicaciones.

Durante años, los jueces citaron la ley para desestimar demandas contra Facebook, Twitter y YouTube, asegurándose de que las empresas no asumieran nuevas responsabilidades legales con cada actualización de estado, publicación y vídeo viral. Los críticos dijeron que la ley era una tarjeta para "salir de la cárcel gratis" para los gigantes tecnológicos.

"Si no tienen ninguna responsabilidad final por los daños que se facilitan, tienen básicamente el mandato de ser lo más imprudentes posible", afirma Mary Anne Franks, profesora de Derecho de la Universidad de Miami.

El Tribunal Supremo se negó anteriormente a tratar varios casos que cuestionaban la ley. En 2020, el tribunal rechazó una demanda, presentada por las familias de personas fallecidas en atentados terroristas, que afirmaba que Facebook era responsable de promover contenidos extremistas. En 2019, el tribunal se negó a escuchar el caso de un hombre que dijo que su exnovio enviaba gente a acosarlo usando la aplicación de citas Grindr. El hombre demandó a la aplicación, alegando que el producto era defectuoso.

Sin embargo, el 21 de febrero, el Tribunal tiene previsto juzgar el caso González vs. Google, que fue interpuesto por la familia de un estadounidense muerto en París durante un atentado perpetrado por seguidores del Estado Islámico. En su demanda, la familia afirma que la sección 230 no debería proteger a YouTube de la acusación de que el sitio de vídeos apoyó el terrorismo cuando sus algoritmos recomendaban vídeos del Estado Islámico a los usuarios. La demanda argumenta que las recomendaciones pueden contar como una forma propia de contenido producido por la plataforma, por lo cual quedan fuera de la protección de la sección 230.

Un día más tarde, el tribunal tiene previsto examinar un segundo caso, Twitter vs. Taamneh. Este caso plantea la pregunta acerca de cuándo las plataformas son legalmente responsables de apoyar el terrorismo según la legislación federal.

Eric Schnapper, profesor de Derecho de la Universidad de Washington y uno de los abogados que representan a los demandantes en ambos casos, dijo en una entrevista que los argumentos son tan limitados que no cambiará amplias franjas de Internet. "No se desintegra todo el sistema", dijo.

Sin embargo, Halimah DeLaine Prado, consejera general de Google, declaró en una entrevista que "cualquier fallo negativo en este caso, por mínimo que sea, va a cambiar fundamentalmente el funcionamiento de Internet", ya que podría dar lugar a la eliminación de algoritmos de recomendación que son "parte integral" de la web.

Twitter no respondió a un pedido de comentarios.

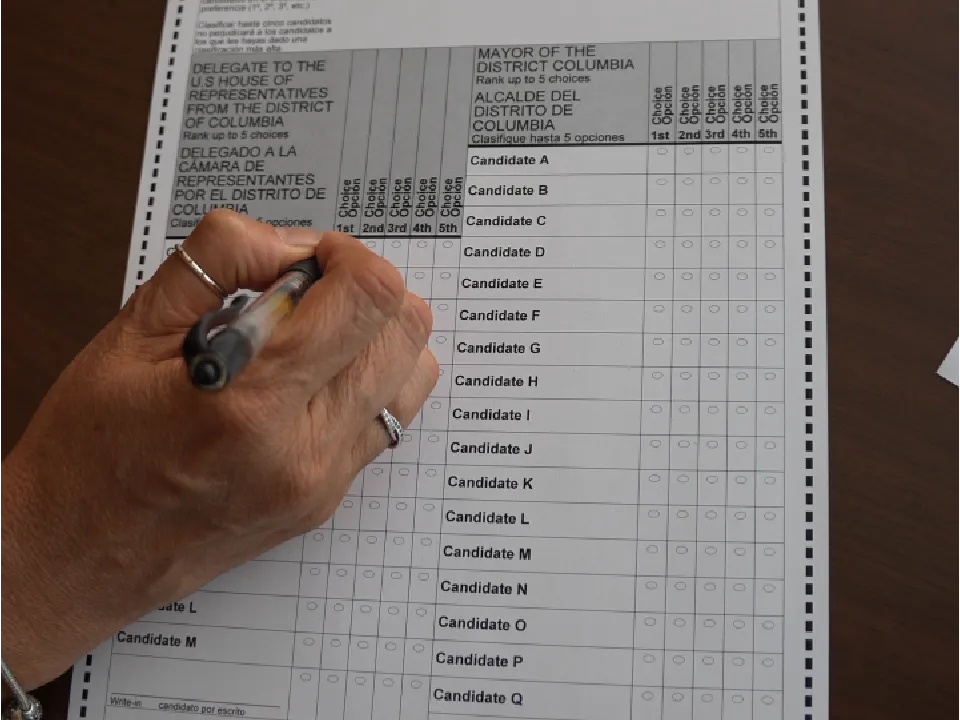

Las empresas tecnológicas también siguen de cerca los casos de Texas y Florida. Ambos estados aprobaron leyes que prohíben a las redes sociales retirar determinados contenidos después de que Twitter y Facebook prohibieran la entrada al entonces presidente Donald Trump tras los disturbios del 6 de enero de 2021 en el Capitolio de EEUU. La ley de Texas permite a los usuarios demandar si una gran plataforma en línea elimina su publicación debido al "punto de vista" que expresa. La ley de Florida multa a las plataformas que prohíben permanentemente las cuentas de un candidato a un cargo en el estado.

NetChoice y CCIA, grupos financiados por Facebook, Google, Twitter y otras empresas tecnológicas, interpusieron una demanda para bloquear las leyes en 2021. Los grupos argumentaron que las empresas tenían un derecho constitucional a decidir qué contenidos albergar.

"Es una forma indirecta de castigar a las empresas por ejercer los derechos de la Primera Enmienda que otros no comparten", dijo un abogado de NetChoice.

En Florida, un juez federal dio la razón a los grupos del sector al dictaminar que la ley vulneraba los derechos de las plataformas amparados por la Primera Enmienda, y el Tribunal de Apelaciones del Circuito 11 de Estados Unidos confirmó la mayor parte de esa decisión. Pero el Tribunal de Apelaciones del Circuito 5 confirmó la ley de Texas, rechazando "la idea de que las corporaciones tienen un derecho irrestricto bajo la Primera Enmienda a censurar lo que dice la gente".

Esto presiona al Tribunal Supremo para que intervenga. Cuando los tribunales federales ofrecen respuestas diferentes a una misma cuestión, el Tribunal Supremo suele optar por dirimir la disputa, explicó Jeff Kosseff, profesor asociado de Derecho de Ciberseguridad en la Academia Naval estadounidense.

David McCabe - The New York Times

Lea el artículo original aquí.