La red social Snapchat, les ofrecerá a los adultos un control parental para que sus hijos interactúen con el chatbot "My AI".

Este cambio, que se anunció el jueves, surgió como respuesta a las preocupaciones de seguridad asociadas a la interacción de los jóvenes usuarios con la herramienta de inteligencia artificial (IA).

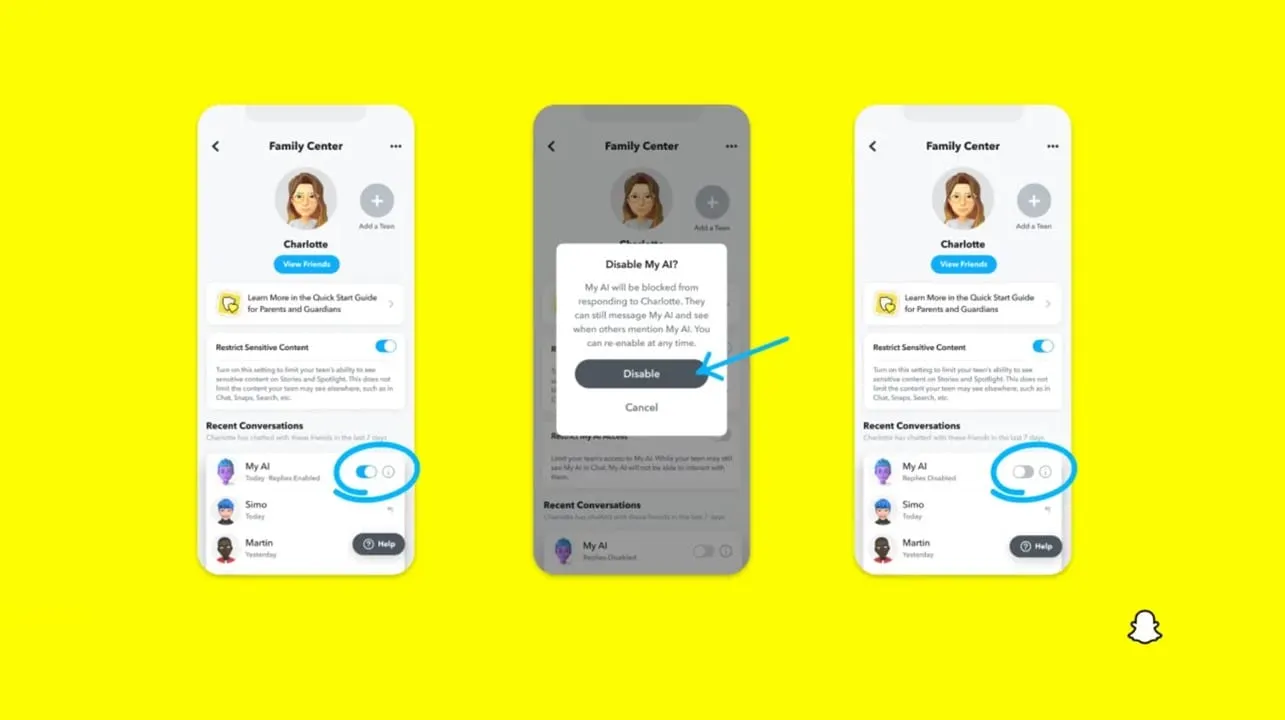

Con esta modificación, los padres pueden desactivar el chatbot, tras lo cual éste responderá a cualquier mensaje de los adolescentes con una notificación sobre su indisponibilidad.

Esta nueva función forma parte de una actualización integral del Centro Familiar de Snapchat, la herramienta de supervisión parental específica de la plataforma.

El lanzamiento del chatbot de IA de la plataforma, en abril, suscitó preocupación entre los padres sobre la facilidad con la que sus hijos podían conversar con el chatbot informático extremadamente personalizado.

En su reciente publicación en el blog, Snapchat tranquilizó a los usuarios asegurándoles que el chatbot My AI cuenta con medidas de protección contra respuestas dañinas o inapropiadas.

El control parental de Snapchat para My AI

El chatbot también impone limitaciones temporales de uso si los usuarios hacen un mal uso repetido del servicio e integra la conciencia de la edad.

Las últimas mejoras del Centro Familiar también permiten a los padres acceder a la configuración de privacidad y seguridad de sus hijos adolescentes.

Con eso, los supervisar las actividades de sus hijos en Snapchat, incluidos sus hábitos a la hora de compartir Historias, sus compañeros de comunicación y la revelación de su ubicación a través de la función en directo "Snap Map".

Introducido en 2022, el Centro Familiar se desarrolló en respuesta a la creciente preocupación por la seguridad de los jóvenes usuarios en diversas plataformas de medios sociales como Snapchat, TikTok, Instagram y YouTube.

El objetivo es permitir a los padres regular las acciones de los usuarios de entre 13 y 17 años.

En noviembre del año pasado, un juez federal dictaminó que Snapchat, junto con Google, Meta y TikTok, tenía que hacer frente a una demanda en la que se alegaba que sus servicios fomentan la adicción entre los usuarios adolescentes, creando problemas adicionales de salud mental.

Desde su creación, no ha dejado de integrar nuevas funciones de seguridad para los jóvenes usuarios. En particular, en septiembre se introdujo un "sistema de huelga" para penalizar a las cuentas que promueven contenidos inapropiados para los adolescentes en las secciones Stories y Spotlight.

"Family Center refleja la dinámica de las relaciones del mundo real entre padres y adolescentes, donde los padres tienen idea de con quién pasan el tiempo sus hijos adolescentes, respetando al mismo tiempo la privacidad de sus comunicaciones personales", declaró la compañía en su publicación.